Con mi Nvidia Spark.

Correr modelos de Inteligencia Artificial "open source" en local es posible con equipos como la Nvidia DGX Spark.

Hace unos días os comentaba que ya tenía mi unidad de NVIDIA Spark conmigo gracias a Ángel Maldonado. Y como podéis en el vídeo que os comparto la unidad es muy chula, con un color dorado y con un acabado frontal y trasero repujado metálico que la hace un dispositivo “elegante” que lo puedes poner en cualquier lugar.

Vivimos un momento en el que la inteligencia parece gratuita, pero el precio es nuestra distinción. Cada vez que usamos una Inteligencia Artificial en la nube, entregamos nuestra intuición, nuestros datos y nuestro estilo a un modelo que nos devuelve una versión promediada de nosotros mismos. Así es más o menos como funciona esto.

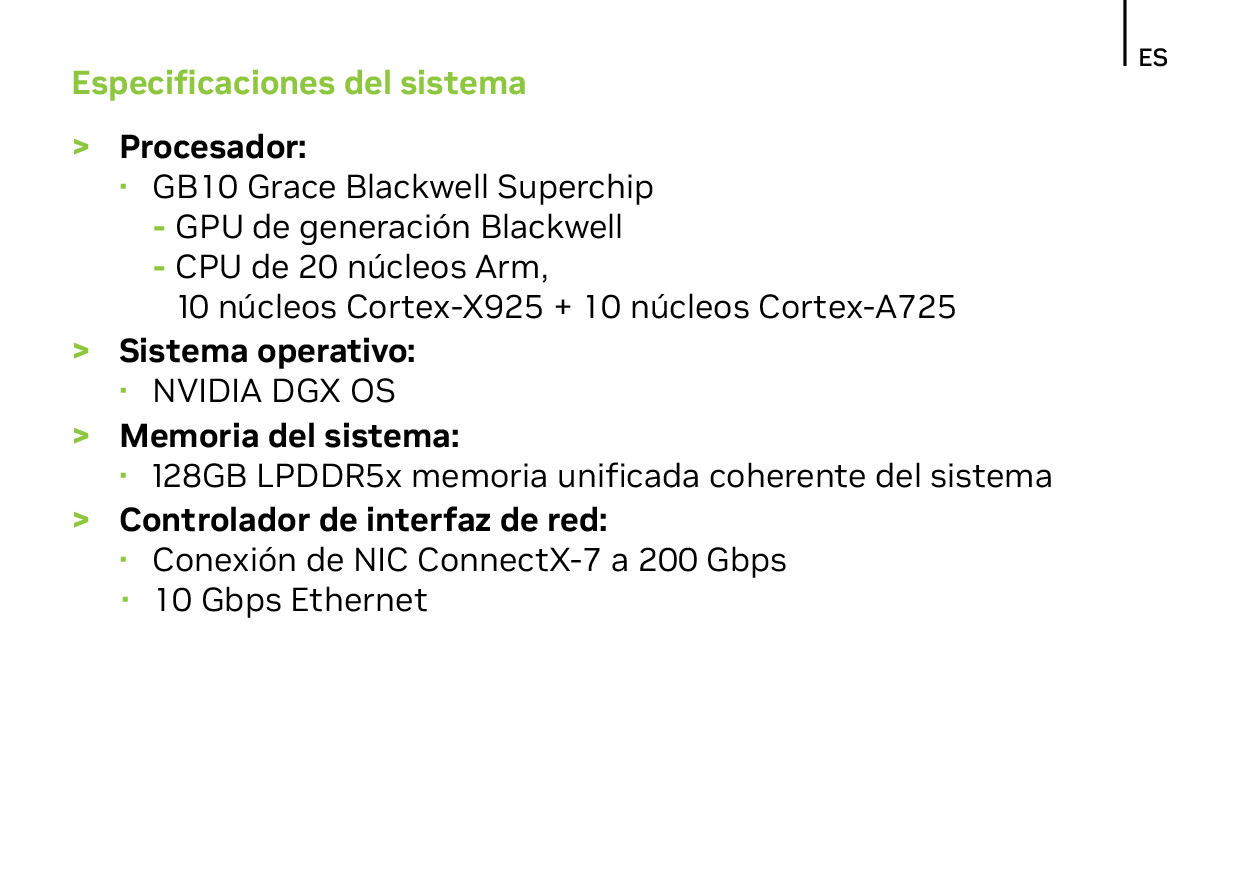

Lo importante de esta unidad es el superchip Nvidia GB10 Blackwell que ofrece un PetaFlop1 de rendimiento que para los menos técnicos como yo es como un Ferrari de los procesadores (igual estoy exagerando un poco). Tiene 128GB de memoria lo que permite crear prototipos, ajustar y crear inferencia con la última generación de modelos de Inteligencia Artificial como Deepseek, Meta, Nvidia, Google, Qwen y otros. Es decir, no tienes que utilizar ningún servicio externo de Google, OpenAI, Claude, Grok...

De la posibilidad de trabajar con una unidad como esta surge un pensamiento basado en tres pilares:

1. La privacidad es el nuevo lujo.

Mis ideas inacabadas, mis estrategias de negocio y mis datos confidenciales no deben alimentar el entrenamiento de modelos de terceros. La verdadera libertad creativa empieza cuando no hay una conexión con un modelo en el exterior. Lo que se piensa en local, se queda en local.

2. El contexto es mi ventaja competitiva

Una IA genérica sabe mucho de todo, pero no sabe nada de mí. Al integrar mi propio corpus de conocimiento, transformo un modelo de lenguaje en una especie de “doble digital”. No le pregunto a internet qué opina; le pregunto a mi propia experiencia procesada por la potencia de cálculo más avanzada del mundo (de momento).

3. La velocidad de pensamiento sin intermediarios

No hay colas de espera, no hay censura externa arbitraria y no hay degradación de servicio. La DGX Spark me devuelve la capacidad de iterar a la velocidad de mi pensamiento. La IA deja de ser una “herramienta de consulta” para convertirse en un músculo cognitivo propio (más o menos). Dicho así igual queda demasiado reivindicativo.

En próximos vídeos os iré contando como funciona la aplicación interna que te permite cargar documentos para poder hacer preguntas al modelo sobre tu propio corpus de información. En nuestro caso el modelo creo recordar que es el Qwen. Y también iremos viendo casos de uso con los que podemos trabajar.

Una buena oportunidad para seguir aprendiendo y compartirlo por aquí. Y si queréis probar esta unidad os podéis acercar por WAX (Work Arena Xixón) que aquí os recibiremos con los brazos abiertos.

Os comparto aquí el vídeo (en formato vertical) para que podáis ver en detalle la Nvidia Spark.

Grandeee Luisma. Ganas ya de ver tus siguientes vídeos y q nos inspires con nuevos casos de uso.

Como comentan por aquí, con ganas de ver algún ejemplo real. "La privacidad es el nuevo lujo", qué razón!

No tengo excusa ninguna pero tengo pendiente escuchar tranquilamente tus entrevistas con Angel y Eva, y echar un buen ojo a Penalty Stroke 🫡